算法的可解释性为什么越来越重要?

浏览次数: 次

可解释性(Explainability) 是指一个系统、模型或决策过程能够被人类理解和解释的能力。

随着人工智能(尤其是深度学习)的快速发展,可解释性成为学术界和工业界关注的核心问题之一,特别是在医疗、金融、法律等高风险领域,模型的透明度和可信度至关重要。

1.为什么需要可解释性?

从根本上来说,AI是为人类服务的,可解释性是连接技术与社会信任的桥梁,是人类对AI进行有效控制和应用的基础。通过跨学科合作(计算机科学、心理学、伦理学)和持续创新,追求实现“高性能且透明”的AI系统,是推动人工智能发展的关键领域。

可解释性的作用体现在如下几个方面:

1)信任与接受度

人们需要理解模型的决策依据和逻辑才能信任其输出。例如:

医疗诊断时,需要解释模型为何判断某患者患有癌症,需定位关键医学特征(如肿瘤形状、生物标志物)。

金融风控时,需要说明拒绝贷款申请的原因(如收入水平、信用历史)。

智驾汽车做出了一个紧急决策时,比如突然刹车,可解释性就应该以可以理解的方式说明突然刹车决策的合理性。

2)社会伦理

人们需要检测模型是否存在歧视、偏见和不公正,确保决策符合社会伦理,保证公平正义。

3)调试与改进

通过解释模型的错误行为,开发者可以优化模型或数据质量。

4)合规性

法律法规要求自动化决策必须提供解释。如欧盟的GDPR(General Data Protection Regulation)。

国家药品监督管理局(NMPA)在医疗器械软件注册审查原则中也对软件算法也提出了可解释性要求。

2.可解释性的核心挑战

1)复杂模型的“黑箱”特性

深度学习模型(如神经网络)通过多层非线性变换提取特征,内部逻辑难以直观解释。在某些情况下,可能只要结果准确,解释并不重要。

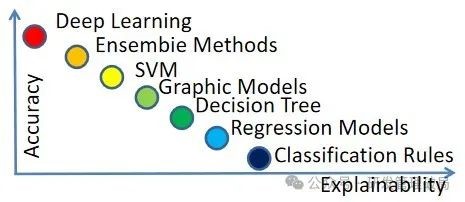

但涉及到重大决策的领域,如医疗等与安全性有关的应用、涉及司法的领域,可解释性就变得关键了。对追求准确性和可解释性之间的权衡是一个关键的挑战。

图片

图片

2)解释的粒度与受众

不同用户需要不同方式的解释以便用户理解(如开发者关注提升性能,用户关注决策的合理性)。

3)解释的真实性

某些解释方法(如事后归因)可能无法反映模型真实推理过程,存在“伪解释”风险。因此需要制定标准和法规,推动可解释性成为AI系统开发的一部分,而不仅仅是事后考虑。

3.可解释性技术分类

1)内在可解释性(Intrinsic Explainability)

使用本身透明的模型(如线性回归、决策树),通过结构直接提供解释。

优点:解释与模型逻辑一致。

缺点:简单模型可能牺牲性能。

2)事后解释(Post-hoc Explainability)

对复杂模型(如神经网络)的输出进行逆向解释,常用方法包括:特征重要性分析、可视化、规则提取、交互式解释。

4.评估可解释性的标准

1)保真度(Fidelity)

解释是否真实反映模型内部的决策逻辑。体现了解释的可靠性。

2)简洁性(Simplicity)

解释是否易于目标用户理解(如避免技术术语)。

3)一致性(Consistency)

相似输入是否生成逻辑一致的解释。

4)实用性(Usefulness)

解释能否帮助用户完成实际任务(如修正错误决策)。